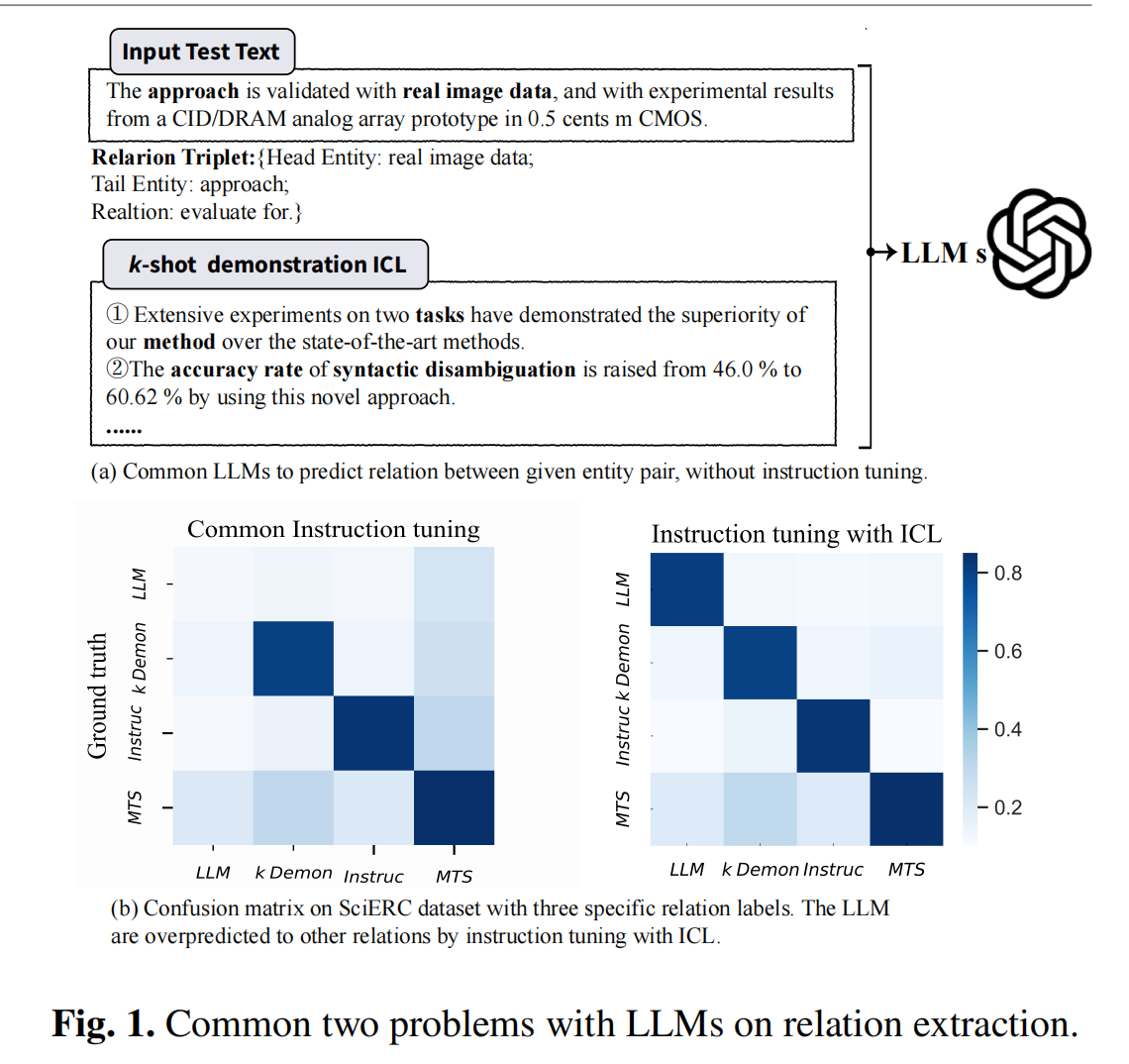

接收期刊:Expert Systems With Applications。中文简介:语言模型的规模化发展已彻底变革了多种 NLP 任务,然而大型语言模型(LLMs)在低资源关系三元组抽取(Relation Triplet Extraction, RTE)领域的探索能力仍未得到充分研究。本文通过系统实验,研究了基于 FlanT5 模型的上下文学习(ICL)的- 样本示例演示和指令微调(Instruction Tuning)的多样本策略,用于少样本与零样本关系三元组抽取。为提升低资源场景性能,我们进一步提出多种类型的演示示例和任务相关指令以生成数据。具体包括(1)利用 LLMs 构建结构化提示模板,基于结构化文本生成合成训练数据;(2)系统性探索指令微调与上下文学习中示例的边界效应问题,评估其对模型性能的影响;(3)针对单句中多关系三元组抽取的挑战,设计新型多重三元组搜索算法(MTS)。